显卡怎么玩 篇三:音频转字幕神器whisper升级版,whisper-webui使用教程

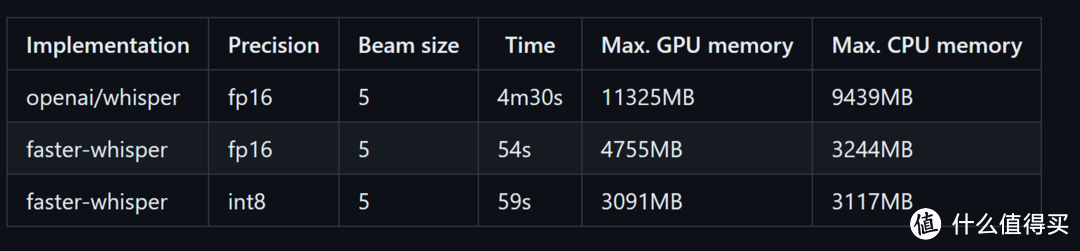

之前介绍过音频转字幕神器whisper,这次介绍一下whisper的webui版。whisper-webui最大的特点除了有webui界面之外,还支持fast-whisper。fast-whisper的生成速度更快需要的显存更小,对显卡的要求更低。官方的说法是显存占用减少一半以上,速度提升3-5倍。我自己实测效果确实更好一点。

和安装whisper的准备工作一样,先安装python3.10(可以根据实际需求部署虚拟环境)。如果显卡支持CUDA可以安装对应的CUDAtoolkit。

然后安装好git。

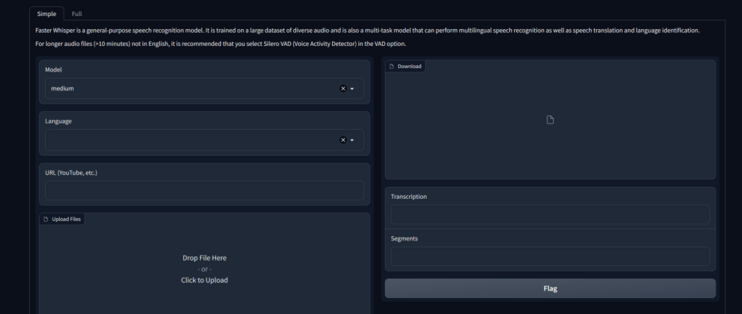

根据实际情况安装对应的torch。前往pytorch官网,根据实际情况设置安装参数,然后拷贝对应的命令安装torch(根据实际情况选择CPU或者cuda版本的torch):

https://pytorch.org/get-started/locally/

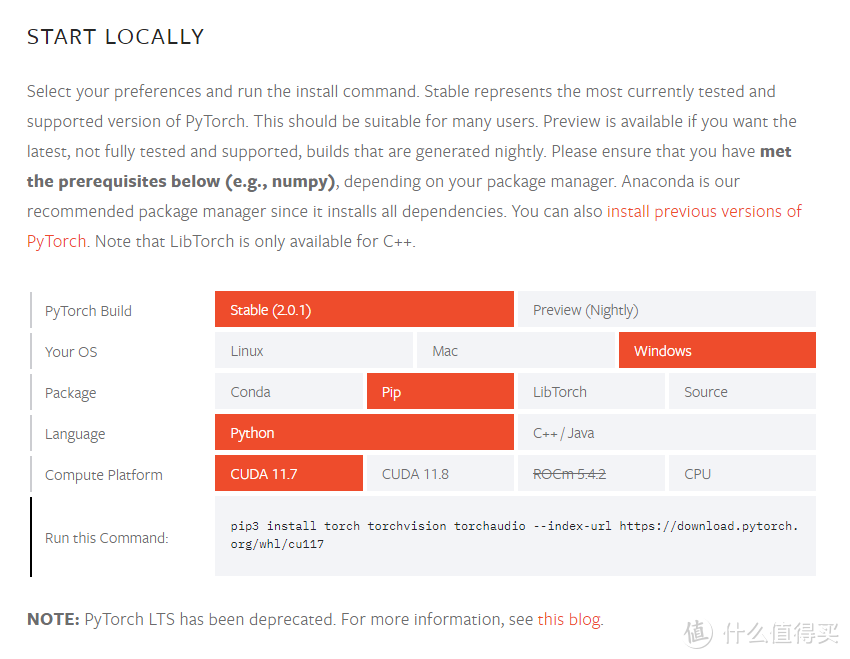

然后安装ffmpeg(下载ffmpeg,把bin目录添加到系列的path环境变量),确保在命令行输入ffmpeg即可正常调用:

接下来折腾whisper-webui,首先把whisper-webui的仓库git下来:

git clone https://huggingface.co/spaces/aadnk/whisper-webui

然后进入目录运行安装命令(安装时间取决于网络):

pip install -r requirements.txt

pip install -r requirements-fasterWhisper.txt

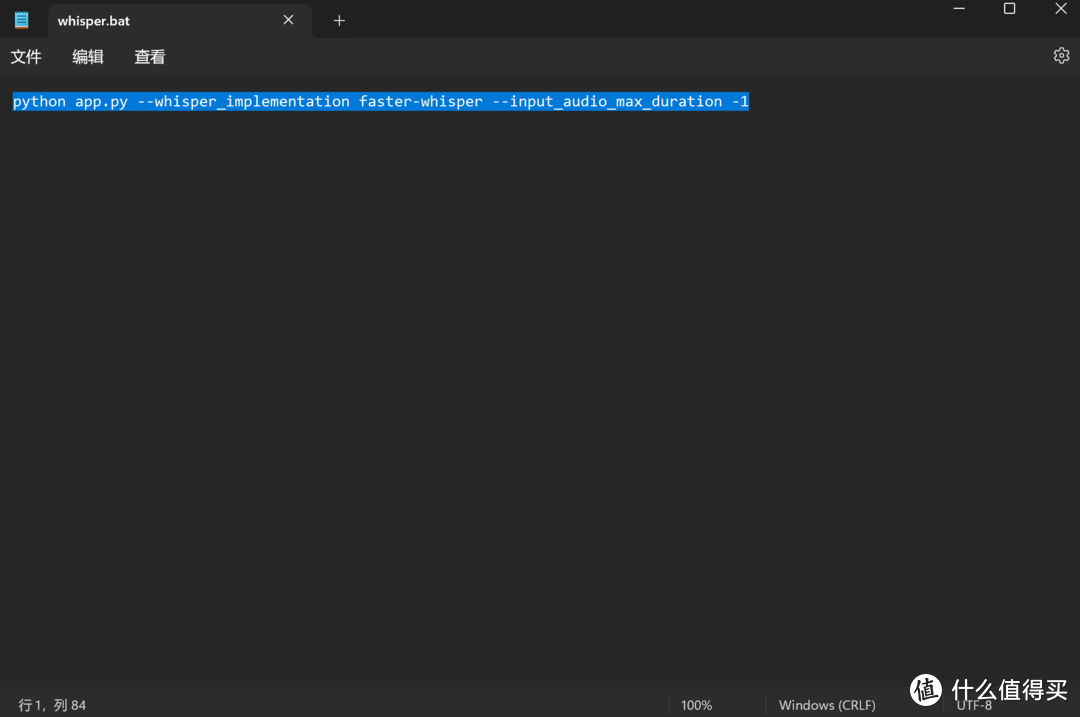

新建一个bat文件,命名为webui.bat输入:

python app.py --whisper_implementation faster-whisper --input_audio_max_duration -1

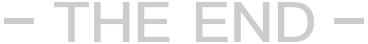

以后双击bat文件即可运行whisper-webui,通过http://127.0.0.1:7860即可访问webui页面:

注意fast-whisper和原版whisper并不公用模型,所以使用过程中需要重新下载模型文件。fast-whisper给出的whisper优化数据,确实比whisper更强,我实际使用中也确实更快一点。

注意whisper-webui需要先将源文件上传至临时文件夹,在转换视频这样的大文件时,需要等待文件上传完毕开能点开始生成的按钮,不然程序会报错。

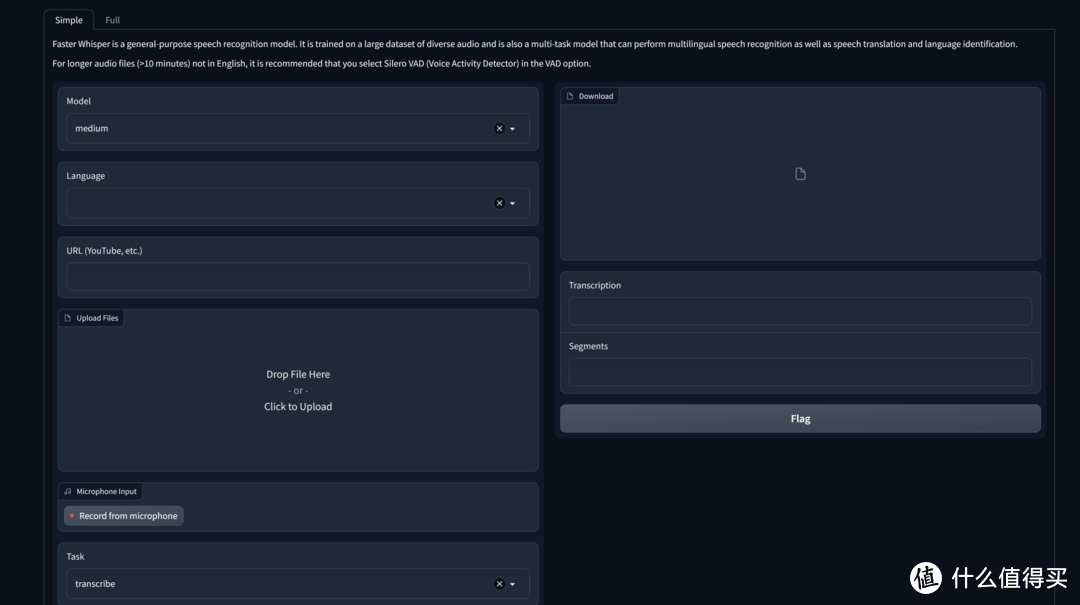

webui界面操作上很直观,就不需要多介绍了,上传文件设置对应的语言和模型点击生成即可。

至于显卡方面,现在玩AI要么性能拉满选RTX4090,要么选RTX3060这样的大显存显卡。

作者声明本文无利益相关,欢迎值友理性交流,和谐讨论~

xyvoid

校验提示文案

wmaing

校验提示文案

wmaing

校验提示文案

xyvoid

校验提示文案