Ai 绘图日常 篇一:SD Upscale的局限

Stable Diffusion WebUI中的SD upscale通过分块重绘再拼接的形式可以实现输出大图的效果,对于中低端显卡来说可以突破硬件上的限制得到分辨率更高的高清图片,对于高端显卡也进一步提高了可输出尺寸。

毕竟默认分辨率512*512对现在的应用来说真的是杯水车薪,即便是文生图或者图生图中极限的2048*2048分辨率对于日渐广泛的4K显示器来说也就只有一半大小。

使用SD upscale分块重绘其实就是就是通过时间换空间来实现高分辨率的图片,但也不是可以无限放大,像我的3060 12显卡再想把4k分辨率的图片翻倍到8k的时候就显存不足了。

不过想要直接生成图片,我用的这款3060 12g并不能做到2048*2048的最大分辨率。

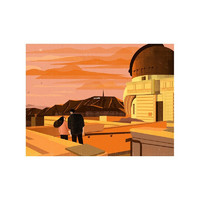

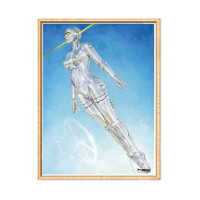

另外图片分块重绘的时候会有重复的像素,默认设置为64像素,一张512*512的图片提升一倍的分辨率需要分割成9张图片来重绘,虽然说花更多的时间也不是不能接受,但从网上了解到再输入参数时对原图的长短边各增加64像素的话上面的例子就只需要分成4张重绘,能一定的减少计算所需时间。但对我这张图来说是有缺陷的。生成的图片中的五官有明显瑕疵(上图和下图)。

另外重绘中使用其他Lora来调整细节这个还是有一定的问题,因为其他模型中训练使用的素材缺乏局部的针对性,像下面两个图就是使用原有参数扩大和增加其他Lora来调整面部。虽然脸是变了,但是衣服材质和衣袖上的材质也有了明显的变化。就换脸来说增加Lora来重绘影响是全局的,是否值得在SD upsacle中应用要具体看图片了。

作者声明本文无利益相关,欢迎值友理性交流,和谐讨论~