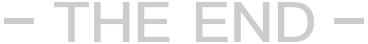

NVIDIA H100 Tensor Core 超算/大语言模型,凌炫GR4208G服务器

购买理由

通过 NVIDIA H100 Tensor Core GPU,在每个工作负载中实现出色性能、可扩展性和安全性。使用 NVIDIA® NVLink® Switch 系统,可连接多达 256 个 H100 来加速百亿亿级 (Exascale) 工作负载,另外可通过专用的 Transformer 引擎来处理万亿参数语言模型。与上一代产品相比,H100 的综合技术创新可以将大型语言模型的速度提高 30 倍,从而提供业界领先的对话式 AI。

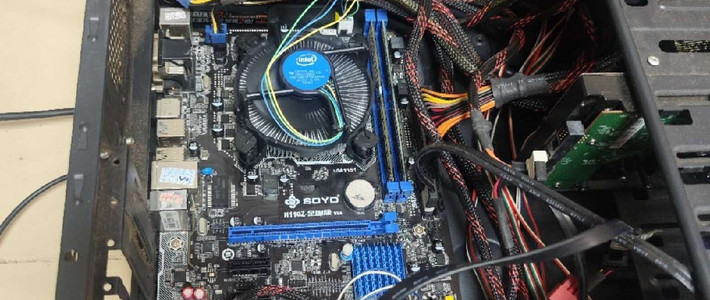

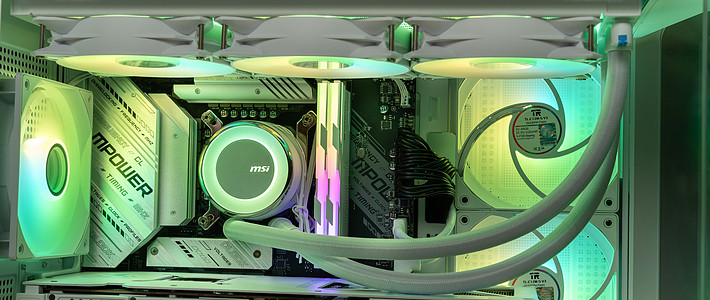

外观展示

使用感受

NVIDIA 数据中心平台性能持续提升,超越摩尔定律。H100 的全新突破性 AI 性能进一步加强了 HPC+AI 的力量,加速科学家和研究人员的探索,让他们全身心投入工作,解决世界面临的重大挑战。

H100 使双精度 Tensor Core 的每秒浮点运算 (FLOPS) 提升 3 倍,为 HPC 提供 60 teraFLOPS 的 FP64 浮点运算。融合 AI 的高性能计算应用可以利用 H100 的 TF32 精度实现 1 petaFLOP 的吞吐量,从而在不更改代码的情况下,实现单精度矩阵乘法运算。

H100 还采用 DPX 指令,其性能比 NVIDIA A100 Tensor Core GPU 高 7 倍,在动态编程算法(例如,用于 DNA 序列比对 Smith-Waterman)上比仅使用传统双路 CPU 的服务器快 40 倍。

Hopper Tensor Core GPU 将为 NVIDIA Grace Hopper CPU+GPU 架构提供支持,该架构专为 TB 级加速计算而构建,可为大型 AI 和 HPC 提供 10 倍的性能。NVIDIA Grace CPU 利用 Arm® 架构的灵活性来创建 CPU 和服务器架构,该架构是专门针对加速计算而从头开始设计的。Hopper GPU 与 Grace CPU 搭配,使用 NVIDIA 超快速的芯片间互连技术,可提供 900GB/s 的带宽,比 PCIe 5.0 快 7 倍。与当今运行最快的服务器相比,这种创新设计将 GPU 的聚合系统显存带宽提高 30 倍,并且会将运行数万亿字节数据的应用性能提高 10 倍。

总结

本机的计算能力

FP64性能:208 TFLOPS

FP64 Tensor Core性能:518 TFLOPS

FP32性能:518 TFLOPS

TF32 Tensor Core性能:6048 TFLOPS

BFLOAT16 Tensor Core性能:12104 TFLOPS

FP16 Tensor Core性能:12104 TFLOPS

FP8 Tensor Core性能:24208 TFLOPS

INT8 Tensor Core性能:24208 TFLOPS