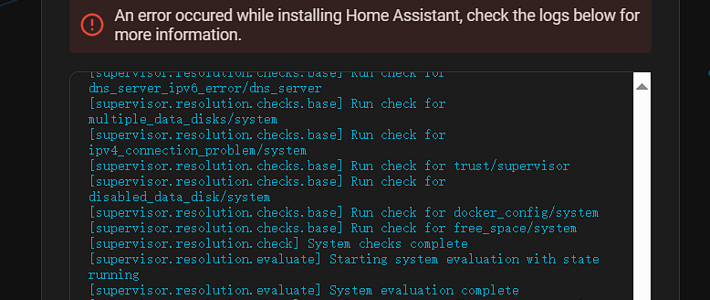

超长上下文!Dolphin 2.2 Yi 34B 200K - GGUF模型概览

模型创建者: Eric Hartford

原始模型: Dolphin 2.2 Yi 34B 200K

模型描述: 这个仓库包含了Eric Hartford的Dolphin 2.2 Yi 34B 200K模型的GGUF格式文件。

GGUF格式简介

GGUF是由llama.cpp团队在2023年8月21日引入的新格式,旨在替代不再支持的GGML格式。

支持GGUF的客户端和库包括llama.cpp、text-generation-webui、KoboldCpp、GPT4All、LM Studio、LoLLMS Web UI、Faraday.dev、llama-cpp-python和candle等。

量化方法与文件

采用不同的量化方法(如Q2_K、Q3_K_S、Q4_K_M等)来优化模型文件大小和性能。

提供了不同位数(如2位、3位、4位等)的GGUF模型,以便在CPU+GPU环境下进行推理。

兼容性

这些量化的GGUFv2文件从2023年8月27日的llama.cpp提交d0cee0d开始兼容。

同时兼容多个第三方用户界面和库。

使用场景

Dolphin 2.2 Yi 34B 200K模型特别适用于多轮对话和共情交流,采用了筛选过的数据集以去除偏见和对齐问题。

建议用户在作为服务公开模型之前实施自己的对齐层,因为模型可能会对任何请求(包括不道德的请求)表现出高度的合规性。

训练与数据集

训练由Convai赞助,使用qLoRA和Axolotl框架,耗时3天在4x A100s上完成3个epochs的训练。

数据集包括Dolphin、Airoboros以及Samantha和WizardLM的数据子集,用于增强创造力和多轮对话能力。

使用指南

提供了使用不同客户端和库,包括Python代码中使用llama-cpp-python或ctransformers库的方法。

提供了与LangChain整合使用的指南。

贡献与支持

Eric Hartford感谢chirper.ai团队、Clay和其他在开源AI社区中提供帮助的人。

提供了Patreon和Ko-Fi链接,以便用户可以财务上支持他的工作。

模型卡片链接

总结

Dolphin 2.2 Yi 34B 200K是一个高度先进且多功能的AI模型,它结合了最新的量化技术和GGUF格式,使得在多种平台和配置下都能有效运行。该模型的开发集中在提高交互质量和共情能力,适用于需求高度个性化和长时间多轮对话的应用场景。同时,Eric Hartford强调了负责任地使用这种强大工具的重要性。